cybersécurité IA : comment les assistants IA détectent les menaces en temps réel

L’IA aide les ÉQUIPES DE SÉCURITÉ à détecter des anomalies et des menaces à grande échelle, et elle le fait en continu. Par exemple, un assistant IA peut surveiller les journaux, corréler la télémétrie et générer une alerte en temps réel lorsque des motifs correspondent à une signature connue ou à une empreinte comportementale inhabituelle. Cette capacité est importante car 77% des entreprises utilisent ou explorent l’IA dans leurs opérations, ce qui explique la forte adoption de l’IA dans les environnements d’entreprise statistique d’adoption de 77 %. En pratique, l’ingestion de télémétrie pilotée par l’IA, l’extraction de caractéristiques et le scoring s’exécutent beaucoup plus rapidement qu’un examen manuel. Le flux commence généralement par télémétrie → un modèle IA → triage des alertes → réponse. Une boucle simple peut ressembler à ceci : des capteurs alimentent des données d’endpoint et de réseau, le modèle IA évalue les anomalies, le système déclenche une alerte, puis le confinement lance un playbook. Cela est particulièrement utile pour la détection des menaces en temps réel, lorsque chaque minute compte.

Les outils de cybersécurité basés sur l’IA alimentent déjà de nombreux pipelines de détection et de réponse. Une revue de l’IA agentique note que l’IA agentique peut s’adapter aux menaces émergentes et agir avec une autonomie cognitive lorsqu’elle est configurée pour le faire IA agentique en cybersécurité. Par conséquent, les plateformes qui combinent des bases comportementales avec une analyse en streaming réduisent le temps de présence de l’attaquant et mettent en évidence des comportements inconnus. Dans un cas d’usage simple, le système détecte un schéma de mouvement latéral, émet une alerte, isole l’endpoint et escalade l’incident vers le SOC pour examen. Cette boucle de confinement automatisée fait gagner du temps et réduit les erreurs humaines.

Les architectes de sécurité doivent décider ce qu’il faut automatiser et ce qu’il faut laisser aux analystes. Pour la surveillance en temps réel, l’IA peut filtrer le bruit et prioriser les menaces de manière à aider les équipes de sécurité à se concentrer sur les incidents à haut risque. En parallèle, les équipes doivent exiger la traçabilité et des scores de confiance pour chaque recommandation, car des études montrent que les sorties d’IA peuvent inclure des inexactitudes et des défaillances de sourcing qui comptent dans un contexte de sécurité étude sur les défaillances de sourcing. De plus, les fournisseurs proposent désormais des plateformes de cybersécurité à base d’IA qui s’intègrent aux flux SIEM, EDR et cloud, permettant un workflow de détection et de réponse rapide tout en gardant les humains dans la boucle pour les décisions critiques.

Pour les organisations qui traitent un fort volume d’e-mails, il existe aussi des applications opérationnelles de l’IA. Par exemple, virtualworkforce.ai utilise des agents IA pour automatiser les cycles de vie des e-mails pour les équipes opérationnelles, router les messages et attacher du contexte aux escalades. Cela réduit le temps perdu en triage et aide les équipes à maintenir une posture de sécurité plus solide dans les communications. En bref, la cybersécurité IA en action détecte les menaces en temps réel et aide à rationaliser la charge opérationnelle qui pourrait autrement distraire le personnel du SOC.

opérations de sécurité : utiliser un assistant IA pour accélérer la détection et la remédiation

Les opérations de sécurité reposent sur des workflows rapides et répétables. L’IA peut automatiser des timelines forensiques, exécuter des playbooks et accélérer la remédiation tout en conservant le contrôle au SOC. Par exemple, les intégrations entre XDR et SOAR permettent à un moteur de suggestions piloté par l’IA de proposer des mesures de confinement, puis un ingénieur peut les approuver ou les remplacer. Ce mélange d’automatisation et de supervision humaine réduit le temps moyen de détection et le temps moyen de remédiation. En fait, l’automatisation diminue la charge des analystes et peut réduire les faux positifs lorsque les corrélations XDR filtrent les signaux bruyants.

Les cas d’usage montrent des bénéfices concrets. Un modèle IA peut analyser des milliers d’alertes, regrouper des incidents similaires et générer un court résumé pour un analyste. Ensuite, l’analyste décide s’il faut escalader. Pour les cas de phishing routiniers, le système peut mettre en quarantaine les messages et marquer les endpoints affectés, puis le SOC passe en revue l’action automatisée. Cette approche aide les équipes SOC à se concentrer sur les enquêtes nécessitant un jugement humain. De plus, l’automatisation de la collecte de preuves et de la construction de la timeline accélère les enquêtes et réduit le risque de manquer des indicateurs.

Les équipes doivent suivre une checklist de gestion du changement avant d’activer des actions automatiques. Premièrement, définir des seuils et des scores de confiance. Deuxièmement, cartographier les playbooks aux rôles et aux approbations. Troisièmement, implémenter la surveillance et des mécanismes de rollback. Quatrièmement, journaliser chaque étape automatisée pour l’auditabilité. Ces étapes aident à protéger l’environnement et à maintenir la conformité. Un tableau de bord pratique affiche les suggestions de l’IA avec des possibilités d’override claires ; cela simplifie le workflow et préserve la responsabilité.

Les métriques à suivre incluent les alertes triées par heure, le taux de faux positifs et le temps de confinement. Ces KPI démontrent l’amélioration tout en maintenant la responsabilité des équipes. De plus, le SOC doit effectuer des vérifications red-team périodiques et des incidents simulés pour valider le modèle IA et réduire le biais d’automatisation chez les analystes. La recherche indique que le biais d’automatisation affecte une grande part des professionnels de la sécurité, d’où l’importance d’étapes de vérification obligatoires facteurs humains et biais d’automatisation. Enfin, les équipes doivent documenter quand le système utilise l’IA pour escalader automatiquement et quand il attend une approbation humaine. Cette politique claire aide à la fois les CISOs et les intervenants de première ligne.

Lorsque vos opérations incluent de lourds flux d’e-mails, envisagez de combiner l’automatisation de la sécurité avec des plateformes d’automatisation des e-mails. virtualworkforce.ai aide les équipes à router et résoudre les e-mails opérationnels, réduisant les contextes bruyants qui font autrement perdre du temps au SOC. Pour en savoir plus sur l’automatisation de la correspondance logistique et la montée en charge des workflows opérationnels, voir cette ressource sur la correspondance logistique automatisée.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

xdr et darktrace : exemples d’IA agentique dans la détection étendue

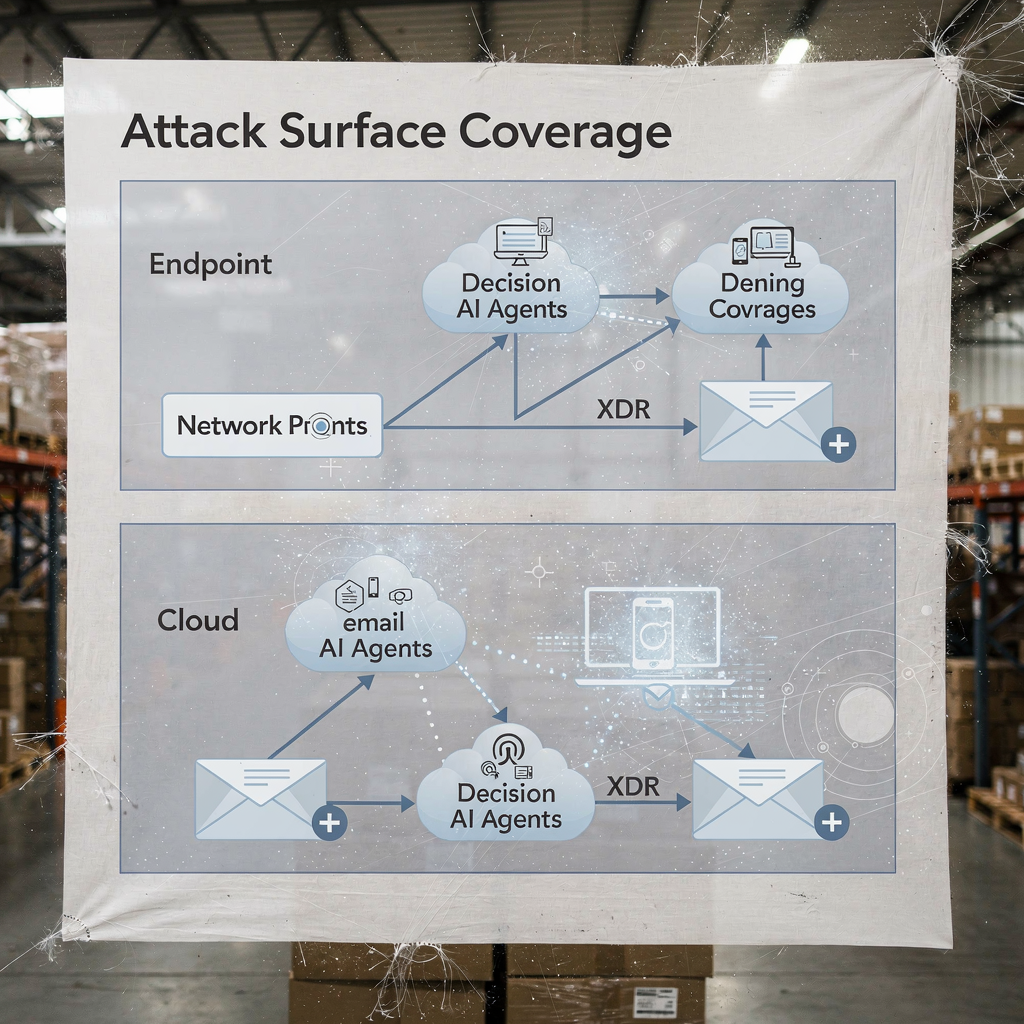

Les plateformes d’Extended Detection and Response unifient les signaux provenant des endpoints, du réseau, du cloud et des e-mails. XDR corrèle ces sources de télémétrie et applique des modèles pour révéler des chemins d’attaque complexes. Darktrace propose de la modélisation comportementale et des fonctionnalités d’IA agentique qui s’adaptent aux baselines changeantes. Dans des mises à jour produits récentes, Darktrace a mis l’accent sur la forensique autonome et les réponses adaptatives, où la plateforme peut prendre des actions de confinement et générer un raisonnement lisible par des humains pour ces étapes. Cette approche donne aux équipes un chemin plus rapide vers la détection et la réponse pour les menaces connues et nouvelles.

Un scénario typique commence par un comportement anomal sur un endpoint qui ne correspond pas à une signature connue. XDR corrèle cette action avec des flux réseau inhabituels, et la plateforme signale un mouvement latéral. Ensuite, une action de confinement isole l’endpoint, tandis que la forensique automatisée capture des artefacts. Les exemples d’IA de Darktrace montrent comment le machine learning peut cartographier les actions d’un attaquant à travers des appareils, puis suggérer une réponse qui isole la surface d’attaque. Cette séquence aide à se défendre contre les ransomwares et la propagation latérale.

L’intégration pratique nécessite une checklist. Premièrement, assurez-vous que votre XDR s’intègre au SIEM et au SOAR pour l’enrichissement des événements. Deuxièmement, cartographiez les playbooks de réponse pour les actions automatiques versus manuelles. Troisièmement, configurez la plateforme pour exporter le contexte vers le ticketing et l’e-mail, afin que les équipes SOC conservent une traçabilité de bout en bout. Quatrièmement, testez les transferts EDR-vers-XDR et confirmez la fidélité de la télémétrie. Un diagramme en couches de la couverture XDR et des points de décision de l’IA clarifie qui agit et quand.

Les bénéfices de XDR s’étendent à la sécurité cloud et aux voies de sécurité des e-mails. La plateforme combine la télémétrie endpoint, les flux réseau et le renseignement sur les menaces pour créer une vision plus large de la posture de sécurité de l’entreprise. Dans les déploiements impliquant Darktrace, les équipes de sécurité peuvent voir des informations sur le comportement des attaquants et des options de confinement rapides. Néanmoins, les équipes doivent valider les décisions de l’IA agentique via des audits et conserver un journal de chaque étape exécutée de manière autonome pour la gouvernance. Pour les organisations dans la logistique et les opérations, intégrer les insights XDR avec l’automatisation des e-mails aide à maintenir la continuité tout en triant les menaces arrivant via le phishing ou des comptes compromis. Voir comment l’IA peut faire évoluer la communication fret et préserver le contexte dans les messages opérationnels IA pour la communication des transitaires.

analyste : biais d’automatisation, limites de précision et l’IA comme aide à la décision

Les facteurs humains influencent la manière dont les équipes adoptent l’IA. Le biais d’automatisation et le biais de confirmation peuvent amener les analystes à trop faire confiance aux sorties de l’IA. Des études montrent que le biais d’automatisation affecte une grande part des praticiens, et les analystes doivent apprendre à considérer l’IA comme une aide à la décision plutôt que comme un oracle facteurs humains dans la cybersécurité pilotée par l’IA. De plus, la recherche a montré que de nombreuses réponses générées par l’IA contiennent des inexactitudes et des problèmes de sourcing, ce qui est critique pour la réponse aux incidents où la confiance dans les faits est essentielle défaillances de sourcing des assistants IA. Ainsi, les responsables SOC devraient ajouter des étapes de vérification obligatoires et des seuils de confiance à chaque recommandation automatisée.

La formation joue un rôle majeur. Les équipes doivent exécuter des scénarios d’entraînement, réaliser des exercices red-team et exiger que les analystes valident les preuves avant de clore un incident. Un contrôle pratique consiste à présenter la provenance pour chaque recommandation afin que les analystes puissent retracer les alertes jusqu’aux journaux bruts et aux états du modèle IA. De plus, introduisez des procédures de gestion des erreurs qui précisent quoi faire lorsque le système affiche une faible confiance ou des sorties incohérentes. Ce processus réduit les risques et maintient l’engagement des humains dans la pensée critique.

La transparence aide aussi. Présenter un résumé expliquant pourquoi une suggestion est apparue, les signaux qui l’ont étayée et la version du modèle qui l’a générée renforce la confiance. Pour le travail analytique qui utilise des résumés en langage naturel, étiquetez-les clairement pour éviter la surconfiance. Parce que l’IA est largement utilisée aujourd’hui, les équipes doivent équilibrer la vitesse et l’examen critique. L’utilisation de scores de confiance et l’exigence d’une validation par un analyste pour les escalades réduisent l’automatisation aveugle.

Enfin, protégez-vous contre la shadow IA dans les équipes. La shadow IA survient lorsque des individus utilisent des outils d’IA générative non autorisés ou des services d’IA générative pour obtenir des réponses rapides. Cette pratique peut entraîner des fuites de données sensibles et introduire une logique incohérente dans les enquêtes. Établissez des outils d’IA générative approuvés et un workflow sécurisé pour toute requête externe ou appel de modèle. Fournissez aux analystes un chemin clair pour escalader les cas complexes. En bref, l’IA doit renforcer l’analyste, et non remplacer le jugement.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

vulnérabilités et données sensibles : l’IA pour surveiller, défendre et créer de nouveaux risques

L’IA aide à trouver des vulnérabilités et à défendre les données sensibles, et pourtant elle introduit des risques à double usage. Du côté défensif, l’IA qui surveille les journaux et le trafic web peut détecter des motifs indiquant des tentatives d’exploitation de CVE, puis déclencher des remédiations pour patcher ou isoler les workloads affectés. Dans le même temps, des acteurs malveillants peuvent déployer des agents IA pour automatiser la reconnaissance, élaborer des phishing ciblés et même générer des variantes de malwares. Des articles sur les menaces émergentes signalent la montée d’employés IA automatisés ou malveillants capables d’effectuer de l’ingénierie sociale de type insider menace des employés IA malveillants. Cette dualité augmente les enjeux pour la gestion des accès aux données sensibles.

Les préoccupations relatives à la vie privée apparaissent lorsque l’IA accède à des journaux contenant des PII ou des secrets opérationnels. Pour éviter les fuites, appliquez des politiques strictes d’accès aux données, utilisez le filtrage d’entrée/sortie et privilégiez les déploiements sur site ou des modèles privés pour les charges sensibles. De plus, journalisez toutes les actions et requêtes de l’IA afin de pouvoir reconstruire les décisions et identifier tout exfiltration de données anormale. Pour les équipes traitant des e-mails opérationnels, veiller à ce que les plateformes d’automatisation des e-mails appliquent le grounding des données et la gouvernance à travers les ERP et les sources documentaires prévient les divulgations accidentelles. Explorez comment l’automatisation des e-mails préserve le contexte et réduit les recherches manuelles dans les workflows logistiques automatisation des e-mails ERP pour la logistique.

Concevez des contrôles pour détecter l’activité malveillante liée à l’IA. Surveillez les volumes de requêtes anormaux et les schémas inhabituels pouvant indiquer un outil de découverte automatisé ou un pipeline d’exfiltration. Mettez en place des throttles et des quotas sur les requêtes qui accèdent à de grands ensembles de données. Menez du threat hunting en partant du principe que les attaquants peuvent exploiter l’IA générative pour créer des campagnes de phishing polymorphes et des messages d’ingénierie sociale plausibles à grande échelle. De plus, examinez les sorties de modèles pour détecter des hallucinations ou des affirmations non étayées, car des défaillances de sourcing peuvent induire en erreur les analystes et conduire à des mesures de remédiation incorrectes.

Enfin, protégez les modèles eux-mêmes. Les attaques de model poisoning et de data poisoning peuvent fausser les modèles d’apprentissage et réduire la précision de détection. Des validations périodiques des modèles et des contrôles de provenance des données aident à détecter tôt les tentatives d’empoisonnement. Conservez des versions signées des modèles et un plan de rollback pour les modèles compromis ou dégradés. Ensemble, ces mesures aident à défendre les données sensibles tout en permettant à l’IA de surveiller et protéger efficacement les systèmes.

sécurité IA et cybersécurité proactive : gouvernance, validation et IA à chaque étape

La gouvernance reste la base d’une adoption sûre de l’IA. Mettez en place la validation de modèles, des tests continus, l’explicabilité et des politiques de cycle de vie avant des déploiements à grande échelle. Exigez la traçabilité et les vérifications de sourcing, effectuez des audits d’exactitude périodiques et utilisez des déploiements par phases avec des critères de rollback. Ces contrôles s’alignent sur des obligations réglementaires telles que le RGPD et les orientations de l’UE sur la minimisation des données et la transparence. De plus, incluez les CISOs dans les revues de gouvernance et exigez des playbooks d’incident clairs couvrant les défaillances de modèle.

Les étapes pratiques comprennent des tests pré-déploiement, la surveillance en runtime, des playbooks d’incident et des critères de rollback définis. Par exemple, tenez un dry run pré-déploiement qui vérifie le modèle IA contre un corpus de test incluant des échantillons malveillants connus, du trafic bruyant et des entrées sensibles à la vie privée. Ensuite, surveillez la dérive et la précision en production et planifiez des audits mensuels. Utilisez des outils d’explicabilité pour fournir aux analystes le raisonnement derrière les décisions clés. De telles étapes rendent les solutions de cybersécurité à base d’IA auditable et digne de confiance.

Adoptez une checklist pour l’utilisation en production : confirmez les contrôles d’accès, implémentez la sanitation des entrées, définissez des politiques de rétention et exigez des journaux signés de chaque action automatisée. Suivez des KPI tels que le taux de faux positifs, le temps de confinement et le pourcentage d’alertes résolues avec supervision humaine. De plus, préparez une feuille de route pour les 90 premiers jours de tout déploiement IA : métriques de référence, essais en sandbox, habilitation par étapes, formation et validation de gouvernance. Cette approche aide à fournir une cybersécurité proactive capable de détecter les menaces connues et inconnues.

Enfin, trouvez l’équilibre entre innovation et prudence. L’IA avancée et l’apprentissage profond apportent de nouvelles capacités aux défenseurs, mais la gouvernance maintient ces capacités alignées sur votre posture de sécurité. Si vous devez monter en charge sans augmenter les effectifs, explorez l’automatisation des flux répétitifs comme le traitement des e-mails opérationnels ; virtualworkforce.ai montre comment des agents IA peuvent réduire le temps de traitement et garder le contexte attaché aux escalades, ce qui soutient à la fois la productivité et les objectifs de sécurité comment faire évoluer les opérations logistiques sans embaucher. Commencez petit, mesurez l’impact et itérez avec des garde-fous clairs.

FAQ

Qu’est-ce qu’un assistant IA en cybersécurité ?

Un assistant IA en cybersécurité est un agent automatisé qui aide à surveiller, analyser et prioriser les événements de sécurité. Il fournit un support à la décision, automatise les tâches d’investigation routinières et met en avant des alertes à haute confiance pour relecture humaine.

Comment les systèmes IA détectent-ils les menaces en temps réel ?

Les systèmes IA ingèrent la télémétrie des endpoints, du réseau et du cloud, puis appliquent des modèles pour détecter des anomalies indiquant une compromission. Ils scorent les événements, regroupent les activités liées et émettent des alertes en temps réel afin que les équipes puissent agir rapidement.

L’IA peut-elle réduire le temps moyen de détection (MTTD) ?

Oui. L’IA accélère le triage en regroupant les alertes, en résumant les preuves et en suggérant des étapes de playbook, ce qui réduit le MTTD. Cependant, les équipes doivent valider les sorties pour éviter le biais d’automatisation et les faux positifs.

Qu’est-ce que le XDR et comment utilise-t-il l’IA ?

XDR signifie Extended Detection and Response et unifie les signaux provenant des endpoints, du réseau, du cloud et des e-mails. Les plateformes XDR utilisent des agents IA et des modèles comportementaux pour corréler les événements et proposer des actions de confinement.

Les recommandations de l’IA sont-elles toujours exactes ?

Non. Des études montrent que les sorties de l’IA peuvent inclure des inexactitudes et des défaillances de sourcing, donc les organisations doivent exiger la traçabilité, des scores de confiance et une vérification humaine. Des audits et des validations réguliers réduisent le risque d’actions erronées.

Comment empêcher l’IA de divulguer des données sensibles ?

Limitez l’accès aux modèles, utilisez le filtrage d’entrée/sortie, privilégiez les options sur site ou les modèles privés pour les charges sensibles et journalisez chaque action de l’IA. Les politiques d’accès aux données et les règles de rétention réduisent également le risque de fuite.

Qu’est-ce que le biais d’automatisation et comment affecte-t-il les analystes de sécurité ?

Le biais d’automatisation survient lorsque les analystes font trop confiance aux sorties de l’IA et négligent la vérification indépendante. Il peut entraîner des anomalies manquées ; la formation, les seuils de confiance et les étapes de vérification obligatoires aident à l’atténuer.

Comment les organisations doivent-elles gouverner l’IA en sécurité ?

La gouvernance doit inclure des tests pré-déploiement, une surveillance continue, l’explicabilité, des vérifications de provenance et des déploiements par phases. Alignez ces contrôles avec des exigences réglementaires comme le RGPD et les cadres de conformité internes.

L’IA peut-elle aider avec la sécurité et les opérations liées aux e-mails ?

Oui. L’IA peut automatiser le tri des e-mails, classifier l’intention, attacher du contexte et rédiger des réponses tout en préservant les pistes d’audit. Les outils qui ancrent les réponses dans les systèmes ERP et les sources documentaires peuvent réduire les recherches manuelles et les expositions de sécurité. Pour des exemples d’automatisation des e-mails en logistique, voir cette ressource sur l’IA dans la communication logistique de fret.

Quelles sont les premières étapes pour déployer un assistant IA en toute sécurité ?

Commencez par un petit pilote, définissez des KPI, effectuez une validation du modèle et exigez des approbations human-in-the-loop pour les actions à fort impact. Préparez aussi des plans de rollback et formez les analystes sur la gestion des erreurs et les procédures de vérification.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.