ai cybersecurity: hogyan észlelik az ai asszisztensek a fenyegetéseket valós időben

Az AI segíti a BIZTONSÁGI CSAPATOKAT abnormális viselkedések és fenyegetések skálázott és folyamatos észlelésében. Például egy AI asszisztens képes naplókat figyelni, telemetriát korrelálni, és valós idejű riasztást megjeleníteni, ha mintázatok egyeznek egy ismert aláírással vagy szokatlan viselkedési ujjlenyomattal. Ez a képesség azért fontos, mert a vállalatok 77%-a már használja vagy vizsgálja az AI-t az üzemeltetésben, ami magyarázza az erős AI-elfogadást a vállalati környezetekben 77%-os elfogadottsági statisztika. A gyakorlatban az AI-vezérelt telemetria-feldolgozás, jellemzőkinyerés és pontozás sokkal gyorsabban fut, mint a manuális ellenőrzés. A folyamat tipikusan telemetria → egy AI modell → riasztás triázs → reagálás menetrenddel kezdődik. Egy egyszerű ciklus így nézhet ki: szenzorok táplálják a végpont- és hálózati adatokat, az AI modell pontozza az anomáliákat, a rendszer riasztást emel, majd a elszigetelés elindít egy playbookot. Ez különösen hasznos a valós idejű fenyegetésészlelésnél, ahol percek számítanak.

Az AI alapú kiberbiztonsági eszközök már számos észlelési és reagálási folyamatot hajtanak. A Review of Agentic AI megjegyzi, hogy az ügynöki MI alkalmazkodni tud a feltörekvő fenyegetésekhez és kognitív autonómiával tud cselekedni, ha így konfigurálják ügynöki MI a kiberbiztonságban. Ezért azok a platformok, amelyek kombinálják a viselkedési alapvonalakat a streaming elemzéssel, csökkentik a tartózkodási időt és kiemelik az ismeretlen viselkedéseket. Egy rövid példa szerint a rendszer észlel laterális mozgást, riasztást ad, izolálja a végpontot, és továbbítja az incidenst az SOC-nak felülvizsgálatra. Ez az automatizált elszigetelési ciklus időt takarít meg és csökkenti az emberi hibát.

A biztonsági tervezőknek el kell dönteniük, mit automatizálnak és mit hagynak az elemzőkre. A valós idejű megfigyelésnél az AI képes kiszűrni a zajt és priorizálni a fenyegetéseket úgy, hogy a csapatok a magas kockázatú eseményekre tudjanak koncentrálni. Ugyanakkor a csapatoknak minden ajánláshoz követelniük kell a provenance-t és a bizalmi pontszámokat, mert a tanulmányok azt mutatják, hogy az AI-kimenetek pontatlanságokat és forrásproblémákat tartalmazhatnak, amelyek számítanak egy biztonsági kontextusban forrásmegjelölési hibákról szóló tanulmány. Emellett a szállítók ma már kínálnak AI-vezérelt kiberbiztonsági platformokat, amelyek integrálódnak SIEM-mel, EDR-rel és felhői feedekkel, lehetővé téve a gyors észlelési és reagálási munkafolyamatot, miközben az embereket kritikus döntések esetén a körben tartják.

Azoknál a szervezeteknél, amelyek nagy email forgalmat kezelnek, operatív AI alkalmazások is vannak. Például a virtualworkforce.ai AI ügynököket használ az ops csapatok e-mail életciklusainak automatizálására, az üzenetek irányítására és az emelésekhez kontextus csatolására. Ez csökkenti a triázsban elvesztegetett időt és segít a csapatoknak erősebb biztonsági álláspontot fenntartani a kommunikációk terén. Röviden, az ai cybersecurity a gyakorlatban egyszerre észleli a fenyegetéseket valós időben és segít egyszerűsíteni az operatív terheket, amelyek különben elterelhetnék az SOC személyzetét.

security operations: ai asszisztens használata az észlelés és helyreállítás felgyorsítására

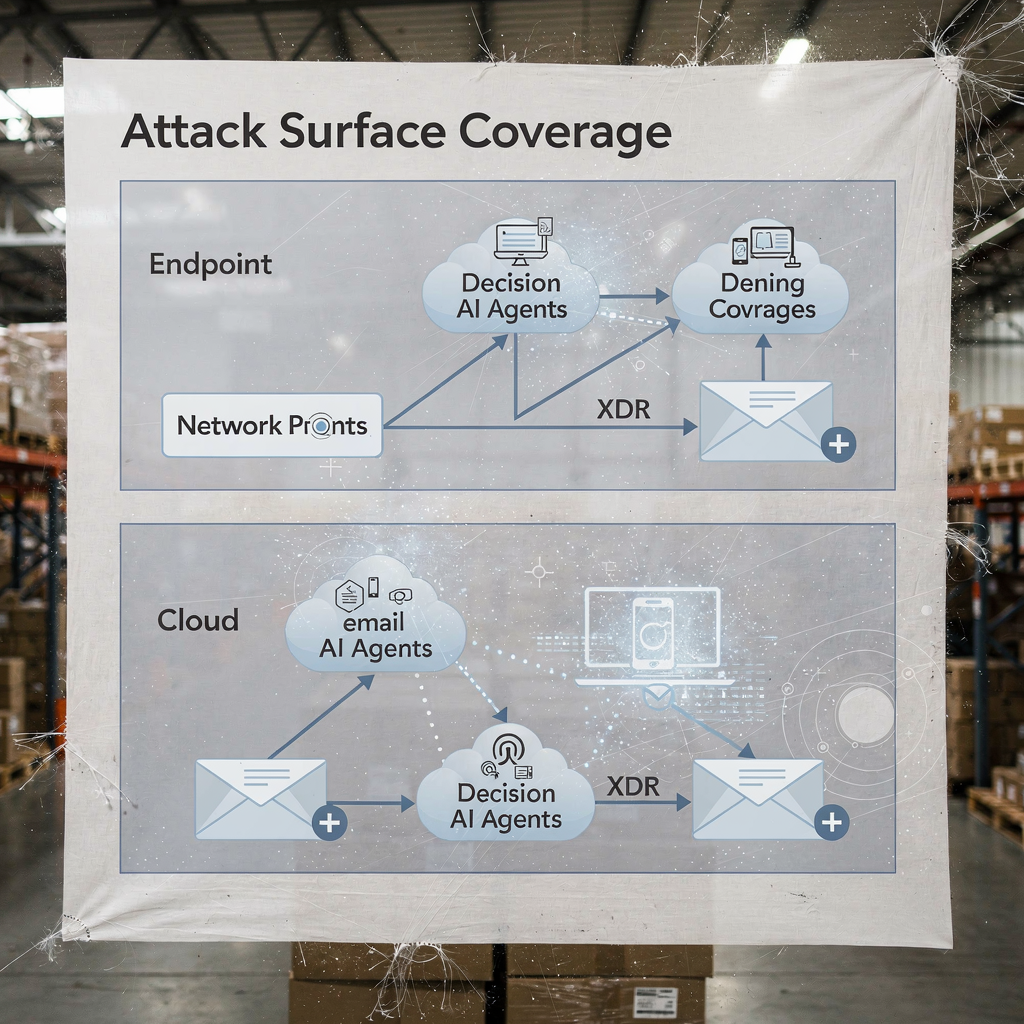

A biztonsági műveletek gyors, ismételhető munkafolyamatokra támaszkodnak. Az AI képes automatizálni a forenzikus idővonalakat, futtatni a playbookokat és felgyorsítani a helyreállítást, miközben az SOC megtartja az irányítást. Például az XDR és SOAR közötti integrációk lehetővé teszik, hogy egy AI-vezérelt javaslatmotor eljárásjavaslatokat tegyen, amelyeket egy mérnök jóváhagyhat vagy felülbírálhat. Ez az automatizálás és emberi felügyelet keveréke csökkenti az észlelésre és helyreállításra fordított átlagidőt. Valójában az automatizálás csökkenti az elemzők terhelését és mérsékelheti a hamis pozitívokat, amikor az XDR korrelációk kiszűrik a zajos jeleket.

A felhasználási esetek gyakorlati előnyöket mutatnak. Egy AI modell képes ezreket feldolgozni a riasztások közül, csoportosítani hasonló incidenst, és rövid összefoglalót generálni egy elemző számára. Ezután az elemző eldönti, hogy emel-e. Rutinszerű adathalász eseteknél a rendszer karanténba helyezheti az üzeneteket és megjelölheti az érintett végpontokat, majd az SOC felülvizsgálja az automatizált lépést. Ez a megközelítés segíti az SOC csapatokat, hogy az emberi ítélőképességet igénylő vizsgálatokra összpontosítsanak. Emellett a bizonyítékgyűjtés és az idővonal-építés automatizálása felgyorsítja a nyomozásokat és csökkenti a mulasztott indikátorok kockázatát.

A csapatoknak változáskezelési ellenőrzőlistát kell követniük, mielőtt automatikus lépéseket engedélyeznek. Először határozzák meg a küszöbértékeket és a bizalmi pontszámokat. Másodszor, illesszék a playbookokat szerepekhez és jóváhagyásokhoz. Harmadszor, vezessenek be monitoringot és visszagörgetési lehetőségeket. Negyedszer, naplózzanak minden automatizált lépést auditálhatóság céljából. Ezek a lépések segítenek megóvni a környezetet és fenntartani a megfelelést. Egy gyakorlati műszerfal AI javaslatokat mutat egyértelmű felülbírálati lehetőségekkel; ez egyszerűsíti a munkafolyamatot és megőrzi a felelősségre vonhatóságot.

A nyomon követendő metrikák közé tartozik a triázsolt riasztások óránként, a hamis pozitív arány és az izolálásig eltelt idő. Ezek a KPI-k javulást mutatnak, miközben számon tartják a csapatokat. Emellett az SOC-nak időszakos red-team ellenőrzéseket és szimulált incidenseket kell futtatnia az AI modell validálására és az automatizálási torzítás csökkentésére az elemzők körében. Kutatások azt jelzik, hogy az automatizálási torzítás jelentős arányban érinti a biztonsági szakembereket, ezért a kötelező ellenőrzési lépések számítanak az emberi tényezők és az automatizálási elfogultság. Végül a csapatoknak dokumentálniuk kell, mikor emeli a rendszer automatikusan az incidenst AI használatával, és mikor vár emberi jóváhagyásra. Ez a világos szabályzat segíti mind a CISO-kat, mind az elsővonalbeli reagálókat.

Ha az üzemeltetéshez nagy e-mail munkaterhelés tartozik, fontolják meg a biztonsági automatizálás és az e-mail automatizációs platformok kombinálását. A virtualworkforce.ai segíti a csapatokat az operatív e-mailek irányításában és megoldásában, csökkentve a zajos kontextusokat, amelyek különben pazarlóan kötnék le az SOC idejét. További információ az üzleti e-mailek automatizálásáról és az operatív munkafolyamatok skálázásáról: automatizált logisztikai levelezés.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

xdr and darktrace: agentic ai examples in extended detection

A kiterjesztett észlelés és reagálás platformok egyesítik a jeleket végpontról, hálózatról, felhőről és e-mailről. Az XDR korrelálja ezeket a telemetriaforrásokat és modelleket alkalmaz, hogy feltárja a komplex támadási útvonalakat. A Darktrace viselkedésmodellezést és ügynöki MI funkciókat kínál, amelyek alkalmazkodnak a változó alapvonalakhoz. A közelmúltbeli termékfrissítésekben a Darktrace hangsúlyozta az autonóm forenzikát és az adaptív válaszokat, ahol a platform izolációs lépéseket tehet és ember számára olvasható indoklást generálhat ezekhez a lépésekhez. Ez a megközelítés gyorsabb utat ad az észleléshez és reagáláshoz mind ismert, mind új típusú fenyegetések ellen.

Egy tipikus forgatókönyv azzal kezdődik, hogy egy végpont szokatlan viselkedést mutat, amely nem egyezik ismert aláírással. Az XDR korrelálja ezt a tevékenységet szokatlan hálózati forgalmakkal, és a platform jelzi a laterális mozgást. Ezután egy elszigetelési művelet izolálja a végpontot, miközben az automatizált forenzika artefaktumokat rögzít. A Darktrace AI példái megmutatják, hogyan képes a gépi tanulás feltérképezni a támadó lépéseit az eszközök között, és javaslatot tenni az attack surface izolálására. Ez a sorrend segít védekezni a zsarolóprogramok és a laterális terjedés ellen.

A gyakorlati integrációhoz ellenőrzőlista szükséges. Először győződjön meg róla, hogy az XDR kapcsolódik a SIEM-hez és a SOAR-hoz az eseménykibővítés érdekében. Másodszor, térképezze fel a válasz playbookokat automatikus és kézi műveletekre. Harmadszor, konfigurálja a platformot úgy, hogy exportálja a kontextust jegykezeléshez és e-mailhez, így az SOC csapatok megőrzik a végponttól-végpontig tartó nyomonkövethetőséget. Negyedszer, tesztelje az EDR–XDR átadásokat és erősítse meg a telemetria hűségét. Egy réteges diagram az XDR lefedettségről és az AI döntéspontokról tisztázza, ki mikor cselekszik.

Az XDR előnyei kiterjednek a felhőbiztonságra és az e-mail biztonsági útvonalakra is. A platform kombinálja a végponti telemetriát, a hálózati forgalmat és a fenyegetésintelligenciát, hogy szélesebb képet adjon a vállalati biztonsági helyzetről. Telepítésekben, amelyekben a Darktrace szerepel, a biztonsági csapatok betekintést nyerhetnek a támadó viselkedésébe és gyors elszigetelési lehetőségekbe. Mégis, a csapatoknak ellenőrizniük kell az ügynöki MI döntéseit auditokkal, és naplózni minden autonóm végrehajtott lépést kormányzási célból. A logisztika és üzemeltetés területén működő szervezetek számára az XDR adatait érdemes integrálni az e-mail automatizációval, hogy folytonosságot tartsanak, miközben triázsálják a adathalászat vagy kompromittált fiókok útján érkező fenyegetéseket. Nézze meg, hogyan skálázhatja az AI a fuvarozói kommunikációt és tarthatja meg a kontextust az operatív üzenetekben: AI a fuvarozói-logisztikai kommunikációban.

analyst: automation bias, accuracy limits and ai is used as decision aid

Az emberi tényezők alakítják, hogyan fogadják el a csapatok az AI-t. Az automatizálási torzítás és a megerősítési torzítás oda vezethet, hogy a biztonsági elemzők túlzottan megbíznak az AI kimeneteiben. Tanulmányok kimutatták, hogy az automatizálási torzítás nagy arányban érinti a gyakorlókat, és az elemzőknek meg kell tanulniuk az AI-t döntéstámogató eszközként kezelni, nem pedig tekintélyként emberi tényezők az MI-vezérelt kiberbiztonságban. Emellett a kutatás megállapította, hogy sok AI által generált válasz pontatlanságokat és forrásproblémákat tartalmaz, ami kritikus egy incidensre adott válaszban, ahol a tények iránti bizalom számít AI-asszisztens forrásmegjelölési hibái. Ezért az SOC vezetőknek kötelező ellenőrzési lépéseket és bizalmi küszöböket kell hozzáadniuk minden automatizált ajánláshoz.

A képzésnek nagy szerepe van. A csapatoknak forgatókönyv-gyakorlatokat kell futtatniuk, red-team gyakorlatokat végezniük, és megkövetelni az elemzőktől, hogy érvényesítsék a bizonyítékokat az incidens lezárása előtt. Egy gyakorlati kontroll, hogy minden ajánláshoz megjelenítik a provenance-t, így az elemzők visszakövethetik a riasztásokat a nyers naplókhoz és az AI modell állapotaihoz. Emellett vezessenek be hibakezelési eljárásokat, amelyek meghatározzák, mit tegyenek, ha a rendszer alacsony bizalommal vagy ellentmondó kimenetekkel dolgozik. Ez a folyamat csökkenti a kockázatot és fenntartja az emberek kritikus gondolkodását.

Az átláthatóság is segít. Mutassák be röviden, miért merült fel egy javaslat, mely jelzések támogatták, és mely modellverzió generálta azt — ez növeli a bizalmat. Az olyan analitikai munkáknál, amelyek természetes nyelvű összefoglalókat használnak, egyértelműen címkézzék ezeket, hogy elkerüljék a túlzott bizalmat. Mivel az AI ma már széles körben használatos, a csapatoknak mérlegelniük kell a sebességet és az ellenőrzést. A bizalmi pontszámok használata és az emelt ügyeknél az elemzői aláírás megkövetelése csökkenti a vak automatizálást.

Végül, óvakodjanak a shadow AI-tól a csapatokban. A shadow AI akkor fordul elő, amikor egyesek nem engedélyezett genai eszközöket vagy gen ai szolgáltatásokat használnak gyors válaszokhoz. Ez a gyakorlat érzékeny adatok kiszivárgásához és következetlen logika bevezetéséhez vezethet a vizsgálatokban. Állítsanak fel jóváhagyott genai eszközöket és biztonságos munkafolyamatot bármilyen külső lekérdezéshez vagy modellhíváshoz. Biztosítsanak az elemzők számára egy világos utat a bonyolult esetek emeléséhez. Röviden, az AI-nak az elemzőt kell felhatalmaznia, nem helyettesítenie az ítélőképességet.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

vulnerability and sensitive data: ai to monitor, defend and create new risks

Az AI segít sebezhetőségek felderítésében és érzékeny adatok védelmében, ugyanakkor kettős használatú kockázatokat is idéz elő. Védelmi oldalon az AI a naplók és a webforgalom figyelésével észlelheti azokat a mintázatokat, amelyek CVE kihasználási kísérletekre utalnak, majd javító intézkedéseket indíthat a patch-elésre vagy az érintett munkaterhelések izolálására. Ugyanakkor a rossz szándékú szereplők AI ügynököket vethetnek be felderítés automatizálására, célzott adathalászok készítésére, sőt kártevő variánsok generálására is. A feltörekvő fenyegetésekről szóló cikkek megemlítik az automatizált vagy rosszindulatú AI alkalmazottak megjelenését, amelyek belső szerű társadalmi mérnökséget hajthatnak végre rosszindulatú AI alkalmazott fenyegetés. Ez a kettősség növeli a tétet az érzékeny adatok hozzáférésének kezelésében.

Adatvédelmi aggályok merülnek fel, amikor az AI olyan naplókhoz fér hozzá, amelyek személyes azonosítóra alkalmas adatokat (PII) vagy üzemeltetési titkokat tartalmaznak. A kiszivárgás ellen szigorú adat-hozzáférési szabályokat kell érvényesíteni, használni bemenet/kimenet szűrést, és érzékeny munkaterhelésekhez előnyben részesíteni a helyszíni vagy privát modell telepítéseket. Emellett naplózzanak minden AI műveletet és lekérdezést, hogy rekonstruálni tudják a döntéseket és azonosítani bármilyen rendellenes adatkivitelt. Azoknál a csapatoknál, amelyek operatív e-maileket kezelnek, biztosítani kell, hogy az e-mail automatizációs platformok alkalmazzanak adat-megalapozást és kormányzást az ERP és dokumentumforrások fölött, hogy megelőzzék a véletlen kiszivárgást. Fedezze fel, hogyan őrzi meg az e-mail automatizáció a kontextust és csökkenti a manuális kereséseket a logisztikai munkafolyamatokban: ERP e-mail automatizálás logisztikában.

Tervezzenek kontrollokat a rosszindulatú AI tevékenység észlelésére. Figyeljék a szokatlan lekérdezési mennyiségeket és a nem megszokott mintázatokat, amelyek automatizált felderítő eszközre vagy adatkiviteli csatornára utalhatnak. Alkalmazzanak lekorlátozásokat és kvótákat azokra a lekérdezésekre, amelyek nagy adatbázisokhoz férnek hozzá. Folytassanak fenyegetésvadászatot úgy, hogy feltételezik: a támadók generatív AI-t használhatnak polimorf adathalászatra és hitelesnek tűnő társadalmi mérnökségi üzenetek tömeges előállítására. Emellett vizsgálják a modellkimeneteket hallucinációk vagy alátámasztatlan állítások után, mert a forrásproblémák megtéveszthetik az elemzőket és helytelen helyreállítási lépésekhez vezethetnek.

Végül védjék magukat a modellek ellen is. A modellmérgezés és adatmérgezés támadások torzíthatják a tanuló modelleket és csökkenthetik az észlelés pontosságát. Rendszeres modellvalidáció és adatproveniencia ellenőrzések segítenek korán felfedezni a mérgezési kísérleteket. Tartsa aláírt modellverziókat és legyen visszagörgetési terve a kompromittált vagy romlott modellekre. Ezek a lépések együtt segítenek megvédeni az érzékeny adatokat, miközben lehetővé teszik, hogy az AI hatékonyan figyelje és védje a rendszereket.

ai security and proactive cybersecurity: governance, validation and ai at every stage

A kormányzás marad a biztonságos AI-elfogadás alapja. Vezessenek be modellvalidációt, folyamatos tesztelést, magyarázhatóságot és életciklus-szabályzatokat a széleskörű bevezetés előtt. Követeljék meg a provenance és forrásellenőrzéseket, végezzenek időszakos pontossági auditokat, és alkalmazzanak szakaszos bevezetéseket visszagörgetési kritériumokkal. Ezek az ellenőrzések összhangban vannak a szabályozói kötelezettségekkel, mint a GDPR és az EU útmutatásai az adatminimalizálásról és átláthatóságról. Emellett vonják be a CISÓ-kat a kormányzási felülvizsgálatokba és követeljék meg világos incidens playbookokat, amelyek a modellhibákat is lefedik.

Gyakorlati lépések között szerepel az előtelepítési tesztelés, futásidőben történő monitoring, incidens playbookok és meghatározott visszagörgetési kritériumok. Például tartsanak egy előtelepítési szárazfutást, amely ellenőrzi az AI modellt egy tesztkorpusszal, amely tartalmaz ismert rosszindulatú mintákat, zajos forgalmat és adatvédelmi szempontból érzékeny bejegyzéseket. Ezután figyeljék a driftet és a pontosságot élesben, és ütemezzenek havi auditokat. Használjanak magyarázhatósági eszközöket, hogy az elemzők megkapják a döntések mögötti indoklást. Ezek a lépések teszik az AI-vezérelt kiberbiztonsági megoldásokat auditálhatóvá és megbízhatóvá.

Alkalmazzanak egy üzembe helyezési ellenőrzőlistát: erősítsék meg a hozzáférésvezérlést, vezessenek be bemenet-sanitizálást, állítsanak be megőrzési szabályokat, és követeljék meg minden automatizált lépés aláírt naplózását. Kövessék olyan KPI-ket, mint a hamis pozitív arány, az izolálásig eltelt idő és az emberi felügyelettel megoldott riasztások százaléka. Készítsenek egy első 90 napos ütemtervet bármilyen AI bevezetéshez: alapvonal metrikák, sandbox tesztek, szakaszos engedélyezés, képzés és kormányzási jóváhagyás. Ez a megközelítés segít proaktív kiberbiztonságot nyújtani, amely észleli az ismert és ismeretlen fenyegetéseket egyaránt.

Végül egyensúlyozzák az innovációt az óvatossággal. Az előrehaladott AI és a deep learning új képességeket hoznak a védelmezők eszköztárába, de a kormányzás tartja ezen képességeket összhangban a biztonsági állásponttal. Ha létszámbővítés nélkül kell skálázni az üzemeltetést, vizsgálják meg az ismétlődő folyamatok, mint az operatív e-mail kezelés automatizálását; a virtualworkforce.ai bemutatja, hogyan csökkenthetik az AI ügynökök a kezelési időt és tarthatják meg a kontextust az emelések során, ami támogatja mind a termelékenységi, mind a biztonsági célokat hogyan bővítsük a logisztikai műveleteket munkaerő felvétel nélkül. Kezdjenek kicsiben, mérjék a hatást, és iteráljanak világos védőkorlátok mellett.

FAQ

What is an AI assistant in cybersecurity?

Egy AI asszisztens a kiberbiztonságban egy automatizált ügynök, amely segít megfigyelni, elemezni és priorizálni a biztonsági eseményeket. Döntéstámogatást nyújt, automatizálja a rutinvizsgálati feladatokat, és magas bizalommal bíró riasztásokat emel emberi felülvizsgálatra.

How do AI systems detect threats in real time?

Az AI rendszerek telemetriát vesznek be végpontokról, hálózatról és felhőről, majd modelleket alkalmaznak anomáliák észlelésére, amelyek kompromittáltságra utalnak. Pontozzák az eseményeket, csoportosítják a kapcsolódó tevékenységeket, és valós idejű riasztásokat emelnek, hogy a csapatok gyorsan tudjanak cselekedni.

Can AI reduce mean time to detect (MTTD)?

Igen. Az AI felgyorsítja a triázst azáltal, hogy csoportosítja a riasztásokat, összefoglalja a bizonyítékokat és javasol playbook lépéseket, ami csökkenti az MTTD-t. Azonban a csapatoknak érvényesíteniük kell a kimeneteket az automatizálási torzítás és a hamis pozitívok elkerülése érdekében.

What is XDR and how does it use AI?

Az XDR a kiterjesztett észlelés és reagálás rövidítése, és egyesíti a jeleket végpontról, hálózatról, felhőről és e-mailről. Az XDR platformok AI ügynököket és viselkedésmodelleket használnak az események korrelálására és elszigetelési lépések javaslatára.

Are AI recommendations always accurate?

Nem. A tanulmányok azt mutatják, hogy az AI kimenetek tartalmazhatnak pontatlanságokat és forrásproblémákat, ezért a szervezeteknek követelniük kell a provenance-t, a bizalmi pontszámokat és az emberi ellenőrzést. A rendszeres auditok és validációk csökkentik a téves intézkedések kockázatát.

How do you prevent AI from leaking sensitive data?

Korlátozza a modellhez való hozzáférést, használjon bemenet/kimenet szűrést, előnyben részesítse a helyszíni vagy privát modell opciókat érzékeny munkaterhelésekhez, és naplózzon minden AI műveletet. Az adat-hozzáférési szabályok és megőrzési irányelvek szintén csökkentik a szivárgás kockázatát.

What is automation bias and how does it affect security analysts?

Az automatizálási torzítás akkor fordul elő, amikor az elemzők túlságosan megbíznak az AI kimenetekben és elhanyagolják a független ellenőrzést. Ez hiányzó anomáliákhoz vezethet; a képzés, a bizalmi küszöbök és a kötelező ellenőrzési lépések segítenek mérsékelni ezt.

How should organisations govern AI in security?

A kormányzásnak tartalmaznia kell az előtelepítési teszteket, folyamatos monitoringot, magyarázhatóságot, provenance ellenőrzéseket és szakaszos bevezetéseket. Ezeket az ellenőrzéseket igazítsák a jogszabályi követelményekhez, mint a GDPR és a belső megfelelőségi keretekhez.

Can AI help with email-related security and operations?

Igen. Az AI képes automatizálni az e-mail triázst, osztályozni a szándékot, csatolni kontextust és vázlatot készíteni válaszokhoz, miközben megőrzi az audit nyomvonalat. Azok az eszközök, amelyek ERP és dokumentumrendszerekre alapozott válaszokat használnak, csökkenthetik a manuális kereséseket és a biztonsági kitettséget. Példák a logisztikai e-mail automatizációra: AI a fuvarozói-logisztikai kommunikációban.

What are the first steps to deploy an AI assistant safely?

Kezdje egy kis pilottal, határozza meg a KPI-ket, végezze el a modellvalidációt, és írjon elő emberi beavatkozást igénylő jóváhagyásokat nagy hatású műveletekhez. Emellett készítsen visszagörgetési terveket és képezze az elemzőket hibakezelésre és ellenőrzési eljárásokra.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.