KI in der Regierung: warum 2025 ein KI-gestützter E-Mail-Assistent für Behörden nötig ist

Posteingänge von Behörden enthalten außergewöhnlich große Mengen an Korrespondenz und sie unterliegen zudem rechtlichen und operativen Pflichten. Zum Beispiel enthalten die US-Regierungsarchive inzwischen Milliarden von Seiten an aufbewahrten E‑Mail‑Aufzeichnungen, was den Druck auf Mitarbeitende erhöht, die Aufzeichnungen pflegen und auf Anfragen antworten müssen wie Forschende berichten. Gleichzeitig ist das weltweite E‑Mail‑Aufkommen stark gestiegen. Branchen‑Schätzungen beziffern das geschäftliche E‑Mail‑Volumen für 2023 auf etwa 347 Milliarden Nachrichten pro Tag, was die administrative Belastung in öffentlichen Poststellen weiter erhöht laut Radicati. Diese beiden Fakten allein erklären, warum Behörden bis 2025 KI in der Regierungs‑kommunikation einführen müssen.

KI kann repetitive Arbeit reduzieren und Mitarbeitende dabei unterstützen, schneller zu antworten. Sie kann Nachrichten kennzeichnen, priorisieren und weiterleiten. Sie kann Antworten entwerfen und strukturierte Aufzeichnungen erstellen. Dadurch sinken die Kosten für FOIA‑Suchen und Rückstände werden abgebaut. Die OECD hebt hervor, wie digitale Transformation und KI die Leistung öffentlicher Dienste und die Umsetzung von Politik beschleunigen in ihrer Untersuchung. Das stärkt die Argumente für den Einsatz von KI für E‑Mails.

Zu den wichtigsten Vorteilen zählen schnellere Antwortzeiten, eine konsistentere Serviceerfahrung und geringere Rückstände. Beispielsweise berichten Programme, die KI‑Agenten einsetzen, von deutlichen Rückgängen der durchschnittlichen Antwortzeit. In operativen Kontexten reduzieren Teams die Bearbeitungszeit um bis zu zwei Drittel, was Zeit spart und Mitarbeitende für höherwertige Aufgaben freisetzt. Ein KI‑Assistent kann zudem das E‑Mail‑Management und die Compliance verbessern, indem er automatisch Aufzeichnungen kennzeichnet und Metadaten für Archive sichert.

Schnelle Metrik‑Beispiele veranschaulichen die Wirkung. Die durchschnittliche Antwortzeit kann um 50–70 % sinken. FOIA‑Suchstunden können um mehrere zehn Prozent fallen, wenn Threads automatisch zusammengefasst werden. Das Verhältnis automatischer Zusammenfassungen pro Posteingang kann stark ansteigen, sodass Mitarbeitende weniger Zeit mit Lesen und mehr Zeit mit Entscheiden verbringen. Diese Ergebnisse sind erreichbar, wenn Behörden von Anfang an Governance, Datenschutz und Integration planen.

Schließlich sollten Führungskräfte im öffentlichen Sektor in Bezug auf Fähigkeit und Kontrolle denken. KI kann als Copilot für Poststellen und Operationsteams fungieren. Sie kann Routinefälle bearbeiten und nur geschäftskritische Fälle eskalieren. Wenn Teams diese Systeme so entwerfen, dass sie automatisieren und gleichzeitig Aufzeichnungen erhalten, entsteht ein E‑Mail‑System, das Transparenz, Nachvollziehbarkeit und Reaktionsfähigkeit bis 2025 unterstützt.

E-Mail‑Management und Workspace: sichere Integration mit Google Workspace

Die Anbindung eines E‑Mail‑Assistenten an Google Workspace erfordert Planung und strikte Kontrollen. Google Workspace bietet integrierte KI‑Funktionen wie Gemini und Enterprise‑Kontrollen, die helfen, Daten zu sichern. Behördenbereitstellungen müssen bundesweite Regeln einhalten und Datenhoheit sowie Aufbewahrungspflichten respektieren. Das Department of Veterans Affairs baut beispielsweise KI‑Strategien auf, die operativen Zugriff betonen und gleichzeitig Governance‑Standards erfüllen wie das VA beschreibt. Dieses Beispiel ist für jede Behörde relevant, die eine Integration plant.

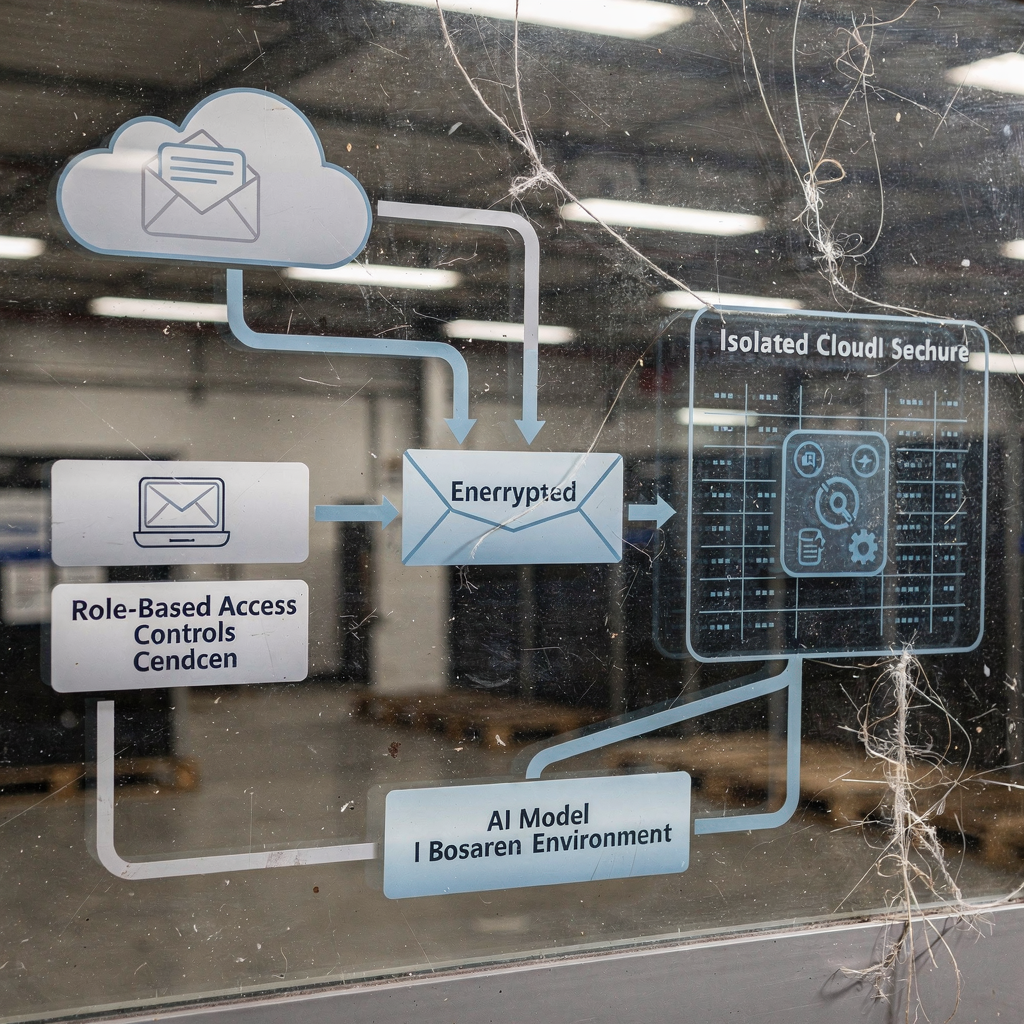

Praktische Schritte beginnen bei Administrator‑Kontrollen und reichen bis zur Datenverlust‑Prävention. Richten Sie zuerst rollenbasierte Authentifizierung ein und begrenzen Sie die Berechtigungen für jede Anwendung. Aktivieren Sie dann DLP und Klassifikation, damit Anhänge und E‑Mail‑Inhalte den richtigen Schutz erhalten. Erzwingen Sie Aufbewahrungsregeln, damit NARA‑Anforderungen und Aktenführungsrichtlinien eingehalten werden. Konfigurieren Sie außerdem die Modellnutzung so, dass Workspace‑Daten nicht in externe Trainingsdaten einfließen, es sei denn, Verträge erlauben diese Nutzung ausdrücklich. Diese Maßnahmen helfen, sensible Daten zu schützen und die Modell‑Exposition zu begrenzen.

Für eine umsetzbare Checkliste sollten Authentifizierung, OAuth‑Scopes, starke Verschlüsselung und umfassende Protokollierung enthalten sein. Sorgen Sie für Verschlüsselung im Ruhezustand und während der Übertragung. Aktivieren Sie Audit‑Trails und exportierbare Metadaten, um die Kette der Verantwortlichkeit zu erhalten. Testen Sie Postfach‑Zugriffe auf Ebene einzelner Mailboxen und stellen Sie sicher, dass der Assistent ohne ausdrückliche Eskalation und Genehmigung nicht handeln kann. Wenn Behörden schnelle Automatisierung bei hoher Kontrolle benötigen, sind Enterprise‑Grade‑Connectoren und private Bereitstellungen am besten geeignet. So lässt sich ein KI‑Assistent integrieren, ohne Datenschutz- oder Cybersicherheitsstandards aufzuweichen.

Betriebs‑Teams sollten auch Lizenzverträge der Anbieter hinsichtlich Klauseln zur Datennutzung für Training und Haftung bei Sicherheitsvorfällen prüfen. Wenn ein Dritter E‑Mails verarbeitet, bestätigen Sie FedRAMP‑ oder gleichwertige Zertifizierungen und bestehen Sie auf vertraglichen Zusagen zur Datenresidenz. Bei Google Workspace sollten Sie hybride Architekturen in Betracht ziehen, bei denen sensible Ordner oder Anhänge in einer behördeninternen Umgebung wie OneDrive oder einer kontrollierten SharePoint‑Instanz verbleiben, während weniger sensible Post Cloud‑Services nutzen. In der Praxis minimiert ein phasenweiser Ansatz das Risiko und erleichtert Onboarding sowie Change‑Management.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

KI‑gestützter Posteingangs‑Workflow: straffen, automatisieren und Antworten beschleunigen

Ein durchdacht gestalteter KI‑gestützter Posteingang schafft wiederholbare, prüfbare Workflows, die Mitarbeitende von wenig wertschöpfenden Aufgaben entlasten. Beginnen Sie mit der Erfassung von Anwendungsfällen für Triage, Zusammenfassung, Weiterleitung und Entwurf. Wählen Sie dann Automatisierungsregeln, die zu diesen Bedürfnissen passen. Typische Workflows priorisieren dringende E‑Mails, kategorisieren Nachrichten automatisch in Ordner und fügen Metadaten hinzu, damit Aktenteams bewahren können, was sie benötigen. Ein E‑Mail‑Assistent kann außerdem Antwortentwürfe vorschlagen, Kalendereinträge extrahieren und Anhänge hervorheben. Wenn diese Funktionen zusammenlaufen, antworten Teams schneller und genauer.

Konkrete Workflows umfassen Prioritätskennzeichnung, automatische Thread‑Zusammenfassung, vorgeschlagene Antworten und FOIA‑Routing. Beispielsweise kann ein Assistent FOIA‑Anfragen automatisch kategorisieren und in einen Akten‑Ordner mit zeitgestempelter Zusammenfassung und Informationen zum ursprünglichen Absender verschieben. Er kann außerdem Aktionspunkte extrahieren und Tickets für einen Projektleiter oder einen operativen Verantwortlichen erstellen. Diese Schritte reduzieren die Suchzeiten nach Kundendaten und vereinfachen Prüfungen.

Automatisierungsoptionen reichen von On‑Device‑Modellen bis zu Enterprise‑Cloud‑Modellen. Nutzen Sie Gmail‑Add‑ons, Google Apps Script und Workspace‑APIs zur Integration mit vorhandenen E‑Mail‑Clients und zur Erhaltung von Metadaten. Wenn Drittanbietermodelle nötig sind, stellen Sie sicher, dass Governance für Daten vorhanden ist, bevor Sie sich mit Lösungen wie ChatGPT oder OpenAI Enterprise verbinden. Virtuelle Teams wählen oft private oder föderierte Bereitstellungen für geschäftskritische Post. Wenn Sie ein logistikorientiertes Beispiel für End‑to‑End‑Automatisierung sehen möchten, das zu Operationen passt, sehen Sie, wie man Logistik‑E‑Mails mit Google Workspace und virtualworkforce.ai automatisiert als praktische Referenz.

Wichtige KPIs sind unter anderem Zeit bis „Inbox Zero“, First‑Response‑SLA und FOIA‑Erfüllungszeit. Messen Sie auch, wie viele Threads der Assistent ohne menschliches Zutun löst. Diese Kennzahlen zeigen sowohl den Produktivitätsgewinn als auch die Reduktion des Rückstands. Wenn Agenten auf ERP‑ oder SharePoint‑Daten gestützt sind, zitieren Antworten korrekte Informationen und Mitarbeitende sparen Zeit. Ein KI‑Assistent, der sich mit operativen Systemen verknüpft, kann außerdem strukturierte Aufzeichnungen erzeugen, die in die Fallbearbeitung einfließen und Nacharbeiten sowie manuellen Suchaufwand reduzieren.

Sicherheit, Datenschutz und Compliance: sensible Daten beim E‑Mail‑Einsatz mit KI schützen

Der Schutz sensibler Daten ist wesentlich, wenn Behörden KI zur Mail‑Verwaltung einsetzen. Es bestehen reale Risiken, wie unbeabsichtigte Offenlegung klassifizierter Inhalte, Trainingsdaten‑Lecks und irrtümliche automatisierte Offenlegungen im Rahmen von FOIA. Forschende weisen auf Verhaltensdaten‑wissenschaftliche Datenschutzprobleme hin, die entstehen, wenn Systeme Kommunikation in großem Umfang analysieren in aktuellen Studien. Behörden müssen Kontrollen entwerfen, die diese Risiken unterbinden.

Erforderliche Kontrollen sind unter anderem Verschlüsselung im Ruhezustand und während der Übertragung, rollenbasierter Zugriff und unveränderliche Audit‑Trails. Fügen Sie einen Human‑in‑the‑Loop für sensible Antworten hinzu. Verwenden Sie Redaktionen für klassifizierte Inhalte und beschränken Sie automatisierte Aktionen bei markierten Absendern. Behörden sollten Richtlinien implementieren, die eine ausdrückliche Genehmigung verlangen, bevor der Assistent Anhänge oder Metadaten weitergibt. Erzwingen Sie zudem Modellnutzungsrichtlinien, die untersagen, operative E‑Mail‑Daten für das Modelltraining zu verwenden, sofern nicht Verträge und Genehmigungen dies zulassen.

Richtlinien müssen Aufbewahrung und Erhalt von Aufzeichnungen gemäß NARA und bundesstaatlichen Regeln abdecken. Anbieter‑Verträge sollten Klauseln zur Datennutzung für Training, Haftung bei Verletzungen und Eigentum an erzeugten Inhalten enthalten. Regelmäßige Audits und Red‑Team‑Tests sind notwendig, um Kontrollen zu validieren. Sicherheitsfunktionen wie Phishing‑Erkennung, Anomalieerkennung und Echtzeit‑Überwachung verringern die Chance eines Kompromisses. Behörden sollten Enterprise‑Grade‑Isolation und ISO‑ oder FedRAMP‑Konformität für gehostete Dienste verlangen.

Betrieblich sollten Sie einen klaren Eskalationspfad und einen dokumentierten Rollback‑Plan bereithalten, falls Automatisierungen unerwartet handeln. Schulen Sie CIOs und Sicherheitsteams darin, wie das System Anhänge und Metadaten behandelt. Für zusätzliche Anleitung zur Verankerung von KI in operativen Datenquellen, sodass Antworten korrekt bleiben, sehen Sie ein Beispiel unseres virtuellen Assistentenansatzes für die Logistik, um zu verstehen, wie strukturierte Datenerfassung in der Praxis funktioniert lesen Sie das Beispiel. Halten Sie zudem Transparenz gegenüber der Öffentlichkeit über automatisierte Prozesse und protokollieren Sie automatisierte Entscheidungen, damit Prüfer nachvollziehen können, warum eine Nachricht auf eine bestimmte Weise behandelt wurde.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

Bester KI‑E‑Mail‑Assistent: Auswahlkriterien, Vorlagen und Evaluation für Behörden

Die Auswahl des besten KI‑E‑Mail‑Assistenten erfordert eine klare Checkliste und ein realistisches Pilotdesign. Beginnen Sie mit zwingenden Auswahlkriterien. Bestehen Sie auf Datenresidenz und Garantien zur Trainingsnutzung. Fordern Sie FedRAMP oder gleichwertige Zertifizierungen und den Nachweis der Prüfbarkeit. Fragen Sie nach Erklärbarkeit der Ausgaben und der Fähigkeit zur Integration mit Google Workspace sowie mit operativen Systemen wie ERP oder SharePoint. Bestätigen Sie Latenz‑ und Kostenziele. Diese Schritte schützen Behörden während der Modernisierung.

Weitere praktische Kriterien sind Unterstützung für thread‑bewusstes Gedächtnis, strukturierte Datenauswertung und Enterprise‑Grade‑Sicherheit. Stellen Sie sicher, dass Anbieter‑Verträge die Nutzung von Daten für Training einschränken und Haftungs‑Klauseln bei Sicherheitsverletzungen enthalten. Bewerten Sie, wie der Assistent mit Metadaten, Anhängen und Ordnerverwaltung umgeht. Testen Sie, ob das Produkt Nachrichten automatisch kategorisieren kann und ob es die für FOIA und Aufbewahrung erforderlichen Informationen bewahrt. Wenn Sie einen vorlagengetriebenen Ansatz möchten, der Suchzeiten reduziert und die Antwortqualität erhöht, bietet virtualworkforce.ai Beispiele zur E‑Mail‑Entwurfsautomatisierung für die Logistik, die den gesamten Lebenszyklus und die Rückverfolgbarkeit zeigen siehe ein Vorlagenbeispiel.

Beziehen Sie eine Reihe von Vorlagen für den Pilot mit ein. Stellen Sie FOIA‑Bestätigungsformulierungen, kurze öffentliche Antworten, interne Briefing‑Zusammenfassungen und Vorlagen für dringende Eskalationen bereit. Testen Sie Auto‑Triage‑Labels und führen Sie eine Stichprobe automatisierter Antworten mit menschlicher Prüfung durch. Planen Sie den Pilot für 8–12 Wochen. Wählen Sie eine Testgruppe, die unterschiedliche Postfachtypen und Volumina abbildet. Definieren Sie Erfolgskennzahlen wie Reduktion der durchschnittlichen Bearbeitungszeit, Abbau des Rückstands und Verbesserung der First‑Response‑SLA. Bereiten Sie außerdem einen Rollback‑Plan und eine Onboarding‑Checkliste für Admins und Fachbereiche vor.

Berücksichtigen Sie schließlich Change‑Management. Schulen Sie Mitarbeitende und richten Sie einen Nutzer‑Feedback‑Kanal ein. Überwachen Sie Modelldrift und planen Sie jährliche Compliance‑Überprüfungen. Wenn Behörden eine Lösung wählen, die sich mit operativen Daten integriert und Aufzeichnungen bewahrt, erhalten sie konsistente Antworten und eine sauberere Prüfspur. Diese Ergebnisse machen die Serviceerfahrung verlässlicher und helfen der Organisation, öffentliche Zusagen einzuhalten.

Bereitstellen und Skalieren: Automatisierung nutzen, ChatGPT/OpenAI einsetzen und 2025 ein nahtloses E‑Mail‑Erlebnis sicherstellen

Die Bereitstellung und Skalierung eines KI‑gestützten E‑Mail‑Assistenten erfordert einen phasenweisen Ansatz. Starten Sie mit einem Pilot, validieren Sie Workflows und führen Sie dann einen gestaffelten Roll‑out und einen kontinuierlichen Verbesserungszyklus durch. Der Pilot sollte Automatisierungslogik, Sicherheitskontrollen und Benutzerakzeptanz testen. Nach der Validierung erfolgt ein gestufter Roll‑out über Teams und gemeinsame Postfächer. Überwachen Sie KPIs, sammeln Sie Feedback und iterieren Sie. Diese Methode reduziert Ausfallzeiten und lässt Mitarbeitende sich anpassen, während das System reift.

Anbieter wie OpenAI und ChatGPT Enterprise bieten leistungsfähige Modelle, die die Entwicklung beschleunigen können. Behörden müssen jedoch Verträge sichern, die Datenisolierung garantieren und die Nutzung von Daten für Training einschränken. Viele Teams bevorzugen private oder föderierte Bereitstellungen für geschäftskritische Post. Wenn Sie planen, diese Modelle zu nutzen, verlangen Sie Enterprise‑Isolation und explizite vertragliche Regelungen zur Datennutzung. Das schützt sensible Daten und erfüllt Prüferanforderungen.

Langfristige Governance ist ebenfalls wichtig. Richten Sie ein Operationsteam ein, das Modelldrift überwacht und Vorlagen sowie Regeln verwaltet. Führen Sie jährliche Audits und Red‑Team‑Tests durch. Bieten Sie regelmäßige Schulungen an und legen Sie fest, wer ein KI‑Modell oder eine Automatisierungsregel ändern darf. Bestimmen Sie außerdem einen Projektmanager, der zwischen IT, Aktenführung, Recht und der Frontlinie koordiniert. Für operationell fokussierte Organisationen zeigen Beispiele, wie man ohne Neueinstellungen skaliert; diese Fallstudien demonstrieren, dass der richtige Assistent Bearbeitungszeiten reduziert und die Produktivität steigert siehe ein verwandtes Beispiel.

Um das E‑Mail‑Erlebnis nahtlos zu halten, stimmen Sie Workflows auf kontextbezogene Antworten und korrektes Anhängemanagement ab. Nutzen Sie thread‑bewusstes Gedächtnis, damit der Assistent weiß, was bereits diskutiert wurde. Halten Sie Vorlagen knapp und sorgen Sie für menschliche Kontrolle bei sensiblen Fällen. Messen Sie abschließend die Auswirkungen auf Produktivität, eingesparte Zeit und Serviceerfahrung. Mit sorgfältiger Governance und klar definierten Automatisierungen können Behörden einen KI‑Assistenten für den Government‑Einsatz bereitstellen, der Aufzeichnungen bewahrt, Antwortzeiten verbessert und sich bis 2025 nachhaltig skalieren lässt.

FAQ

Was ist ein KI‑E‑Mail‑Assistent und wie hilft er Behörden?

Ein KI‑E‑Mail‑Assistent ist ein Software‑Agent, der E‑Mails liest, klassifiziert und Antwortentwürfe erstellt. Er hilft Behörden, indem er Routineaufgaben automatisiert, die Antwortgeschwindigkeit erhöht und Aufzeichnungen organisiert, sodass Mitarbeitende sich auf höherwertige Aufgaben konzentrieren können.

Wie verbessert KI die FOIA‑Bearbeitung und Aktenrecherchen?

KI kann Threads automatisch zusammenfassen, E‑Mails mit relevanten Metadaten kennzeichnen und FOIA‑Anfragen an Akten‑Teams weiterleiten. Das reduziert Suchzeiten und hilft sicherzustellen, dass Aufbewahrungs‑ und Offenlegungsregeln eingehalten werden.

Kann ein Assistent sicher in Google Workspace integriert werden?

Ja. Die Integration erfordert Admin‑Kontrollen, DLP, strikte OAuth‑Scopes und Verschlüsselung im Ruhezustand sowie während der Übertragung. Behörden sollten außerdem vertragliche Zusagen verlangen, dass Workspace‑Daten nicht ohne Genehmigung für Modelltraining verwendet werden.

Lernen KI‑Tools wie ChatGPT oder OpenAI aus unseren E‑Mails?

Das hängt vom Vertrag und dem Bereitstellungsmodell ab. Enterprise‑Angebote können Datenisolation zusichern, während öffentliche Modelle Daten für Training verwenden können. Prüfen Sie stets Klauseln zur Datennutzung in Anbietervereinbarungen.

Welche Schutzmaßnahmen verhindern die versehentliche Offenlegung sensibler Daten?

Obligatorische Schutzmaßnahmen sind Redaktionen, rollenbasierter Zugriff, Audit‑Logs und menschliche Überprüfung für markierte Nachrichten. Regelmäßige Audits und Red‑Team‑Tests verringern das Risiko zusätzlich.

Wie lange sollte ein Pilot dauern und was sollte er messen?

Piloten laufen typischerweise 8–12 Wochen. Messen Sie Kennzahlen wie First‑Response‑SLA, Rückgang des Rückstands, Zeit bis Inbox Zero und den Anteil der Threads, die ohne menschliches Zutun gelöst werden.

Welche Vorlagen sollten Behörden für automatisierte Antworten vorbereiten?

Beginnen Sie mit einer FOIA‑Bestätigung, einer kurzen öffentlichen Antwort, einer internen Briefing‑Zusammenfassung und einer Vorlage für dringende Eskalationen. Testen Sie jede Vorlage vor der vollständigen Automatisierung mit menschlicher Prüfung.

Kann ein KI‑Assistent Aufzeichnungen für NARA‑Konformität bewahren?

Ja. Richtig gestaltete Assistenten fügen Metadaten hinzu, speichern Anhänge in geschützten Ordnern und exportieren Audit‑Logs. Stellen Sie sicher, dass das System Aufbewahrungsregeln durchsetzt und den Export von Aufzeichnungen unterstützt.

Wie stellen wir die Erklärbarkeit KI‑generierter Antworten sicher?

Fordern Sie vom Anbieter Erklärbarkeitsfunktionen wie Begründungs‑Metadaten, Quellenzitate und nachvollziehbare Entscheidungsprotokolle. Menschliche Überprüfung bei sensiblen Antworten hilft ebenfalls, nachzuvollziehen, warum eine Antwort erzeugt wurde.

Welche Rolle haben menschliche Prüfer nach der Bereitstellung?

Menschliche Prüfer übernehmen Eskalationen, validieren sensible Antworten und verfeinern Vorlagen. Sie prüfen auch die Ausgaben des Assistenten und unterstützen kontinuierliche Verbesserungen, damit die Serviceerfahrung mit Richtlinien und öffentlichen Erwartungen übereinstimmt.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.