AI-sikkerhet: hvordan AI-assistenter oppdager trusler i sanntid

AI hjelper SIKKERHETSTEAM med å oppdage avvik og trusler i stor skala, og det gjør det kontinuerlig. For eksempel kan en AI-assistent overvåke logger, korrelere telemetri og vise et sanntidsvarsel når mønstre samsvarer med en kjent signatur eller et uvanlig atferdsfingeravtrykk. Denne kapasiteten er viktig fordi 77% av selskaper enten bruker eller utforsker AI i drift, noe som forklarer den sterke AI-adopsjonen i virksomhetsmiljøer 77% adopsjonsstatistikk. I praksis kjører AI-drevet telemetriinntak, funksjonsuttrekking og scoring mange ganger raskere enn manuell gjennomgang. Flyten starter typisk med telemetri → en AI-modell → varseltriage → respons. En enkel sløyfe kan se slik ut: sensorer mater endepunkt- og nettverksdata, AI-modellen scorer avvik, systemet utløser et varsel, og deretter igangsettes inneslutning ved et playbook. Dette er spesielt nyttig for sanntids trusseldeteksjon der minutter betyr mye.

AI-cybersikkerhetsverktøy driver allerede mange deteksjons- og responsrørledninger. En Review of Agentic AI bemerker at agentisk AI kan tilpasse seg nye trusler og handle med kognitiv autonomi når det er konfigurert for det agentisk AI i cybersikkerhet. Derfor reduserer plattformer som kombinerer atferdsbaser med strømanalyse oppholdstid og fremhever ukjente atferder. I ett kort brukstilfelle oppdager systemet et lateralt bevegelsesmønster, utsteder et varsel, isolerer endepunktet og eskalerer hendelsen til SOC for gjennomgang. Den automatiserte inneslutningssløyfen sparer tid og reduserer menneskelige feil.

Sikkerhetsarkitekter må bestemme hva som skal automatiseres og hva som skal overlates til analytikere. For sanntidsovervåking kan AI filtrere støy og prioritere trusler på en måte som hjelper sikkerhetsteam å fokusere på hendelser med høy risiko. Samtidig bør team kreve proveniens og konfidensscorer for hver anbefaling, fordi studier viser at AI-utdata kan inneholde unøyaktigheter og kildefeil som betyr noe i en sikkerhetskontekst studie om kildefeil. I tillegg tilbyr leverandører nå AI-drevne cybersikkerhetsplattformer som integreres med SIEM, EDR og skytilførsler, og gjør mulig en rask deteksjons- og responsflyt samtidig som mennesker beholdes i loopen for kritiske beslutninger.

For organisasjoner som håndterer et høyt e-postvolum, finnes det også operative AI-applikasjoner. For eksempel bruker virtualworkforce.ai AI-agenter for å automatisere e-postlivssykluser for driftsteam, rute meldinger og legge ved kontekst til eskaleringer. Det reduserer tid tapt i triage og hjelper team med å opprettholde en sterkere sikkerhetsstilling i kommunikasjon. Kort sagt oppdager AI-sikkerhet i praksis både trusler i sanntid og bidrar til å strømlinjeforme operativt arbeid som ellers kan distrahere SOC-personell.

Sikkerhetsoperasjoner: bruke AI-assistent for å gi raskere deteksjon og utbedring

Sikkerhetsoperasjoner er avhengige av raske, repeterbare arbeidsflyter. AI kan automatisere forensiske tidslinjer, kjøre playbooks og akselerere utbedring mens SOC beholder kontrollen. For eksempel tillater integrasjoner mellom XDR og SOAR at en AI-drevet forslagmotor foreslår inneslutningstiltak, og så kan en ingeniør godkjenne eller overstyre dem. Denne blandingen av automatisering og menneskelig overvåking reduserer gjennomsnittlig tid til deteksjon og gjennomsnittlig tid til utbedring. Faktisk reduserer automatisering analytikerens arbeidsbelastning og kan kutte falske positive når XDR-korrelasjoner filtrerer støyende signaler.

Brukstilfeller viser praktiske fordeler. En AI-modell kan analysere tusenvis av varsler, gruppere lignende hendelser og generere et kort sammendrag for en analytiker. Deretter avgjør analytikeren om det skal eskaleres. For rutinemessige phishing-saker kan systemet sette meldinger i karantene og markere berørte endepunkter, og så gjennomgår SOC den automatiserte handlingen. Denne tilnærmingen hjelper SOC-team med å fokusere på undersøkelser som krever menneskelig vurdering. Også automatisering av innsamling av bevis og konstruksjon av tidslinjer fremskynder undersøkelser og reduserer risikoen for savnede indikatorer.

Team bør følge en endringsstyringssjekkliste før de aktiverer automatiske handlinger. Først, definer terskler og konfidensscorer. For det andre, kartlegg playbooks til roller og godkjenninger. For det tredje, implementer overvåking og tilbakestillinger. For det fjerde, loggfør hvert automatiserte steg for revisjonssporbarhet. Disse trinnene bidrar til å sikre miljøet og opprettholde etterlevelse. Et praktisk dashbord viser AI-forslag med klare overstyringsmuligheter; dette effektiviserer arbeidsflyten og bevarer ansvarlighet.

Måleparametre å spore inkluderer varsler triagert per time, falsk positiv-rate og tid til inneslutning. Disse KPI-ene viser forbedring samtidig som de holder teamene ansvarlige. I tillegg bør SOC regelmessig kjøre red-team-sjekker og simulerte hendelser for å validere AI-modellen og redusere automatiseringsskjevhet blant analytikere. Forskning indikerer at automatiseringsskjevhet påvirker en stor andel sikkerhetsfagfolk, og derfor er obligatoriske verifikasjonstrinn viktige menneskelige faktorer og automatiseringsskjevhet. Til slutt bør team dokumentere når systemet bruker AI for å automatisk eskalere, og når det venter på menneskelig godkjenning. Denne klare policyen hjelper både CISO-er og frontlinjerespondenter.

Når driften din inkluderer mye e-postarbeid, vurder å kombinere sikkerhetsautomatisering med plattformer for e-postautomatisering. virtualworkforce.ai hjelper team med å rute og løse operative e-poster, og reduserer støyende kontekster som ellers sløser SOC-tid. For mer om å automatisere logistikk-e-post og skalere operative arbeidsflyter, se denne ressursen om automatisert logistikkkorrespondanse.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

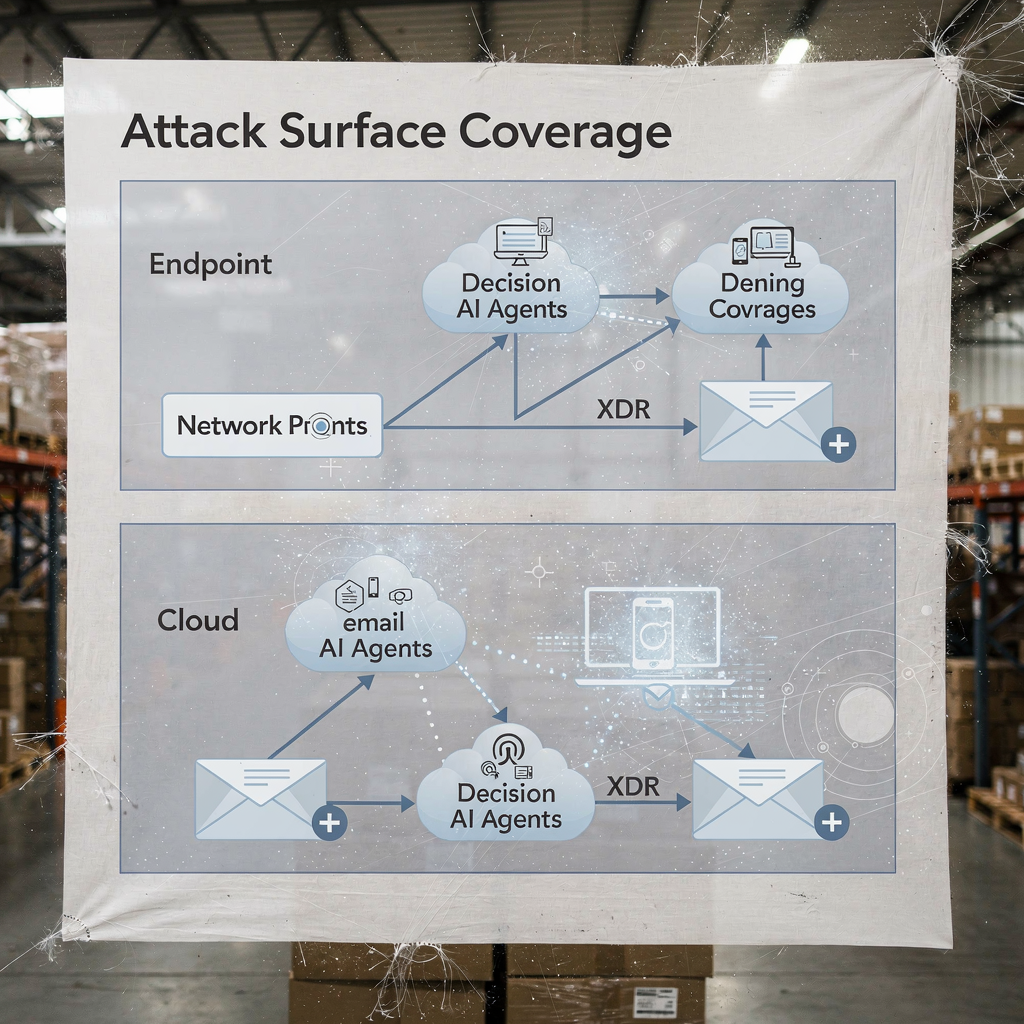

XDR og Darktrace: eksempler på agentisk AI i utvidet deteksjon

Utvidede deteksjons- og responsplattformer samler signaler fra endepunkt, nettverk, sky og e-post. XDR korrelerer disse telemetrikildene og anvender modeller for å avdekke komplekse angrepsveier. Darktrace tilbyr atferdsmodellering og agentiske AI-funksjoner som tilpasser seg endrede baselines. I nyere produktoppdateringer la Darktrace vekt på autonom etterforskning og adaptive responser, der plattformen kan ta inneslutningstiltak og generere menneskelesbare begrunnelser for disse stegene. Denne tilnærmingen gir team en raskere vei til deteksjon og respons for både kjente og nye trusler.

Et typisk scenario starter med anomal atferd på et endepunkt som ikke samsvarer med en kjent signatur. XDR korrelerer den handlingen med uvanlige nettverksstrømmer, og plattformen flagger lateral bevegelse. Så isolerer et inneslutningstiltak endepunktet, mens automatisert etterforskning fanger artefakter. Darktrace-eksempler viser hvordan maskinlæring kan kartlegge en angripers handlinger på tvers av enheter, og deretter foreslå et svar som isolerer angriperens angrepsflate. Den sekvensen bidrar til å forsvare mot ransomware og lateral spredning.

Praktisk integrasjon krever en sjekkliste. Først, sørg for at XDR kobles til SIEM og SOAR for hendelsesenrikelse. For det andre, kartlegg responsplaybooks for automatiske versus manuelle handlinger. For det tredje, konfigurer plattformen til å eksportere kontekst til ticketing og e-post, slik at SOC-team beholder ende-til-ende sporbarhet. For det fjerde, test EDR-til-XDR-overføringer og bekreft telemetrifidelitet. Et lagdelt diagram av XDR-dekning og AI-beslutningspunkter klargjør hvem som handler og når.

XDRs fordeler strekker seg til sky- og e-postsikkerhetsbaner. Plattformen kombinerer endepunktelemetri, nettverksstrømmer og trusselintelligens for å skape et bredere bilde av virksomhetens sikkerhetsstilling. I utplasseringer som involverer Darktrace, kan sikkerhetsteam se innsikt i angriperatferd og raske inneslutningsmuligheter. Likevel bør team validere agentiske AI-beslutninger gjennom revisjoner og opprettholde en logg over hvert autonomt utførte steg for styring. For organisasjoner innen logistikk og drift hjelper integrering av XDR-innsikt med e-postautomatisering å opprettholde kontinuitet samtidig som man triager trusler som kommer via phishing eller kompromitterte kontoer. Se hvordan AI kan skalere fraktkommunikasjon og bevare kontekst i operative meldinger AI for speditørkommunikasjon.

Analytiker: automatiseringsskjevhet, nøyaktighetsbegrensninger og AI brukt som beslutningsstøtte

Menneskelige faktorer former hvordan team tar i bruk AI. Automatiseringsskjevhet og bekreftelsesskjevhet kan føre til at sikkerhetsanalytikere stoler for mye på AI-utdata. Studier viser at automatiseringsskjevhet påvirker en stor andel praktikere, og analytikere må lære å behandle AI som en beslutningsstøtte snarere enn et orakel menneskelige faktorer i AI-drevet cybersikkerhet. I tillegg fant forskning at mange AI-genererte svar inneholder unøyaktigheter og kildeproblemer, noe som er kritisk for hendelsesrespons der tillit til fakta betyr noe AI-assistent kildefeil. Derfor bør SOC-ledere legge til obligatoriske verifikasjonstrinn og konfidenssterskler for hver automatiserte anbefaling.

Opplæring spiller en stor rolle. Team bør kjøre scenariodriller, utføre red-team-øvelser og kreve at analytikere validerer bevis før en hendelse lukkes. En praktisk kontroll er å vise proveniens for hver anbefaling slik at analytikere kan spore varsler tilbake til rålogger og AI-modelltilstander. Innfør også feilbehandlingsprosedyrer som angir hva som skal gjøres når systemet viser lav konfidens eller inkonsistente utdata. Denne prosessen reduserer risiko og holder mennesker engasjert i kritisk tenkning.

Åpenhet hjelper også. Å presentere et sammendrag av hvorfor et forslag oppstod, signalene som støttet det, og modellversjonen som genererte det bygger tillit. For analytisk arbeid som bruker naturlige språk-sammendrag, merk dem tydelig for å unngå overdreven tillit. Fordi AI nå er mye brukt, må team balansere hastighet med gransking. Bruk av konfidensscorer, og krav om analytikers sign-off ved eskaleringer, reduserer blind automatisering.

Til slutt, vær på vakt mot shadow AI i teamene. Shadow AI oppstår når enkeltpersoner bruker uautoriserte genAI-verktøy eller genAI-tjenester for raske svar. Denne praksisen kan lekke sensitiv data og introdusere inkonsistent logikk i undersøkelser. Etabler godkjente genAI-verktøy og en sikker arbeidsflyt for alle eksterne spørringer eller modellkall. Gi analytikere en klar vei for å eskalere komplekse saker. Kort sagt, AI bør styrke analytikeren, ikke erstatte vurderingsevne.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.

Sårbarheter og sensitive data: AI for overvåking, forsvar og nye risikoer

AI hjelper med å finne sårbarheter og forsvare sensitive data, samtidig som det introduserer dobbeltnytte-risikoer. På forsvarssiden kan AI for å overvåke logger og webtrafikk oppdage mønstre som indikerer CVE-utnyttelsesforsøk, og så utløse utbedring for å patche eller isolere berørte arbeidsbelastninger. Samtidig kan ondsinnede aktører distribuere AI-agenter for å automatisere rekognosering, utforme målrettet phishing og til og med generere malware-varianter. Artikler om nye trusler påpeker økningen av automatiserte eller ondsinnede AI-ansatte som kan utføre insider-lignende sosial manipulering trussel fra ondsinnet AI-ansatt. Den dualiteten øker innsatsen for hvordan du håndterer tilgang til sensitive data.

Personvern bekymringer oppstår når AI får tilgang til logger som inneholder PII eller operative hemmeligheter. For å beskytte mot lekkasjer, håndhev strenge datatilgangspolicyer, bruk inn- og utdatafiltrering, og foretrekk lokale eller private modellutplasseringer for svært sensitive arbeidsbelastninger. Loggfør også alle AI-handlinger og spørringer slik at du kan rekonstruere beslutninger og identifisere eventuelt unormalt dataegress. For team som håndterer operative e-poster, sørg for at e-postautomatiseringsplattformer anvender datagrunnlag og styring på tvers av ERP- og dokumentsystemer for å forhindre utilsiktet utlevering. Utforsk hvordan e-postautomatisering bevarer kontekst og reduserer manuelle oppslag i logistikkarbeidsflyter ERP-e-postautomatisering for logistikk.

Design kontroller for å oppdage ondsinnet AI-aktivitet. Overvåk for unormale spørringsvolumer og uvanlig mønstring som kan indikere et automatisert oppdagelsesverktøy eller en eksfiltrasjonspipeline. Implementer struping og kvoter for spørringer som får tilgang til store datasett. Utfør trusseljakt som antar at angripere kan bruke generativ AI for å lage polymorfisk phishing og plausibel sosial manipulering i stor skala. Gjennomgå også modellutdata for hallusinasjoner eller udokumenterte påstander, siden kildefeil kan villede analytikere og føre til feil utbedringstiltak.

Til slutt, beskytt selve modellene. Modellforgiftning og datapforgiftning kan vri læringsmodeller og redusere deteksjonsnøyaktigheten. Periodisk modellvalidering og dataprovenienssjekker hjelper med å oppdage forgiftningsforsøk tidlig. Oppretthold signerede modellversjoner og en tilbakestillingsplan for kompromitterte eller degraderte modeller. Tatt sammen hjelper disse trinnene å forsvare sensitive data samtidig som AI kan overvåke og beskytte systemer effektivt.

AI-sikkerhet og proaktiv cybersikkerhet: styring, validering og AI i alle faser

Styring forblir grunnlaget for trygg AI-adopsjon. Implementer modellvalidering, kontinuerlig testing, forklarbarhet og livssykluspolicyer før bred utrulling. Krev proveniens- og kildesjekker, utfør periodiske nøyaktighetsrevisjoner, og bruk stagede utrullinger med kriterier for tilbakestilling. Disse kontrollene samsvarer med regulatoriske forpliktelser som GDPR og EU-veiledning rundt dataminimering og åpenhet. Inkluder også CISOs i styringsgjennomganger og krev klare hendelsesplaybooks som dekker modellfeil.

Praktiske steg inkluderer pre-distribusjonstesting, runtime-overvåking, hendelsesplaybooks og definerte tilbakestillingskriterier. For eksempel hold en pre-distribusjon dry-run som sjekker AI-modellen mot et testkorpus som inkluderer kjente skadelige prøver, støyende trafikk og personvern-sensitive oppføringer. Overvåk deretter drift for drift og nøyaktighet, og planlegg månedlige revisjoner. Bruk forklarbarhetsverktøy for å gi analytikere rasjonale bak viktige beslutninger. Slike tiltak gjør AI-drevne cybersikkerhetsløsninger reviderbare og pålitelige.

Vedta en sjekkliste for produksjonsbruk: bekreft tilgangskontroller, implementer inndatasanitering, sett tilbakeholdningsregler og krev signerede logger for hver automatiserte handling. Spor KPI-er som falsk positiv-rate, tid til inneslutning og prosentandel varsler løst med menneskelig tilsyn. Forbered også en plan for de første 90 dagene ved enhver AI-utrulling: baseline-målinger, sandbox-tester, stagede aktiviseringer, opplæring og styringsgodkjenning. Denne tilnærmingen hjelper med å levere proaktiv cybersikkerhet som kan oppdage både kjente og ukjente trusler.

Avslutningsvis, balanser innovasjon med forsiktighet. Avansert AI og dyp læring bringer nye AI-muligheter til forsvarerens verktøykasse, men styring holder disse mulighetene i tråd med din sikkerhetsprofil. Hvis du trenger å skalere driften uten å øke bemanningen, utforsk automatisering av repeterende arbeidsflyter som operativ e-posthåndtering; virtualworkforce.ai viser hvordan AI-agenter kan redusere behandlingstid og holde kontekst knyttet til eskaleringer, noe som støtter både produktivitet og sikkerhetsmål hvordan skalere logistikkoperasjoner uten å ansette. Start smått, mål effekt og iterer med klare styringsrammer.

FAQ

Hva er en AI-assistent i cybersikkerhet?

En AI-assistent i cybersikkerhet er en automatisert agent som hjelper til med å overvåke, analysere og prioritere sikkerhetshendelser. Den gir beslutningsstøtte, automatiserer rutinemessige undersøkelsesoppgaver og viser varsler med høy konfidens for menneskelig gjennomgang.

Hvordan oppdager AI-systemer trusler i sanntid?

AI-systemer inntar telemetri fra endepunkt, nettverk og sky, og anvender deretter modeller for å oppdage anomalier som indikerer kompromittering. De scorer hendelser, grupperer relatert aktivitet og utløser sanntidsvarsler slik at team kan handle raskt.

Kan AI redusere mean time to detect (MTTD)?

Ja. AI akselererer triage ved å gruppere varsler, oppsummere bevis og foreslå playbook-trinn, noe som senker MTTD. Team må imidlertid validere utdata for å unngå automatiseringsskjevhet og falske positiver.

Hva er XDR og hvordan bruker det AI?

XDR står for extended detection and response og det forener signaler fra endepunkt, nettverk, sky og e-post. XDR-plattformer bruker AI-agenter og atferdsmodeller for å korrelere hendelser og foreslå inneslutningstiltak.

Er AI-anbefalinger alltid nøyaktige?

Nei. Studier viser at AI-utdata kan inneholde unøyaktigheter og kildefeil, så organisasjoner må kreve proveniens, konfidensscorer og menneskelig verifikasjon. Regelmessige revisjoner og validering reduserer risikoen for feilaktige handlinger.

Hvordan forhindrer du at AI lekker sensitiv data?

Begrens modelltilgang, bruk inn- og utdatafiltrering, foretrekk lokale eller private modellalternativer for sensitive arbeidsbelastninger, og loggfør hver AI-handling. Datatilgangspolicyer og tilbakeholdningsregler reduserer også risiko for lekkasje.

Hva er automatiseringsskjevhet og hvordan påvirker det sikkerhetsanalytikere?

Automatiseringsskjevhet oppstår når analytikere stoler for mye på AI-utdata og forsømmer uavhengig verifikasjon. Det kan føre til savnede anomalier; opplæring, konfidenssterskler og obligatoriske verifikasjonstrinn hjelper å dempe dette.

Hvordan bør organisasjoner styre AI i sikkerhet?

Styring bør inkludere pre-distribusjonstesting, kontinuerlig overvåking, forklarbarhet, provenienskontroller og stagede utrullinger. Juster disse kontrollene med regulatoriske krav som GDPR og interne etterlevelsesrammeverk.

Kan AI hjelpe med e-postrelatert sikkerhet og drift?

Ja. AI kan automatisere e-posttriage, klassifisere intensjon, legge ved kontekst og utarbeide utkast til svar samtidig som revisjonsspor bevares. Verktøy som forankrer svar i ERP- og dokumentsystemer kan redusere manuelle oppslag og sikkerhetseksponeringer. For eksempler på e-postautomatisering i logistikk, se denne ressursen om AI i kommunikasjon for godstransportlogistikk.

Hva er de første stegene for å implementere en AI-assistent trygt?

Start med et lite pilotprosjekt, definer KPI-er, utfør modellvalidering, og krev menneske-i-loopen godkjenninger for handlinger med høy innvirkning. Forbered også tilbakestillingsplaner og tren analytikere i feilbehandling og verifikasjonsprosedyrer.

Drowning in emails?

Here’s your way out

Save hours every day as AI Agents label and draft emails directly in Outlook or Gmail, giving your team more time to focus on high-value work.